Вступ

Наукові дослідження вказують на те, що штучний інтелект (ШІ) може відтворювати несправедливі рішення, прийняті людьми в минулому. Це ставить під сумнів загальноприйняте уявлення про неупередженість алгоритмів.

Основні факти

- ШІ може успадковувати упередження з історії суспільства.

- Алгоритми в наймі, фінансах та судочинстві часто підсилюють людські помилки.

- Система може здаватися справедливою, але насправді дискримінує певні групи.

Хронологія дослідження

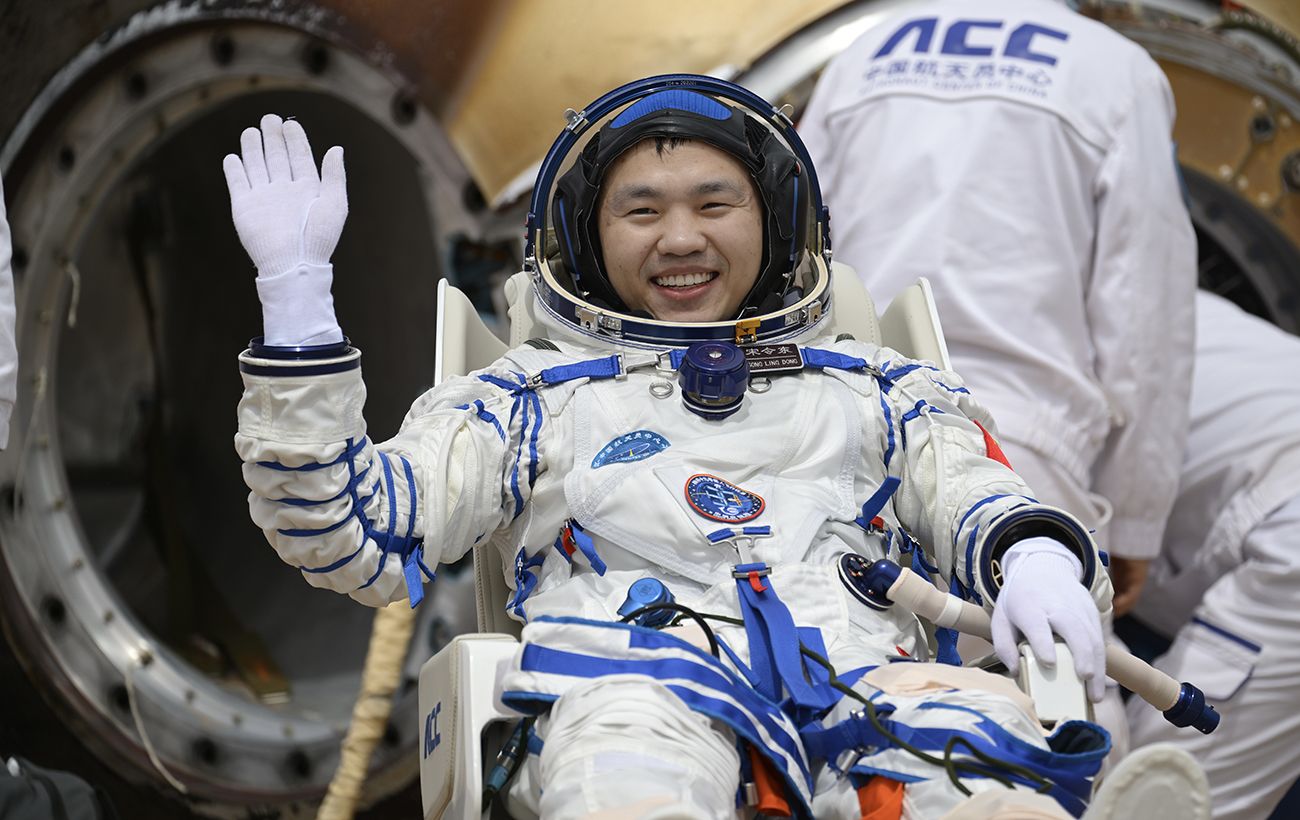

- Вчені проаналізували алгоритми в різних сферах.

- Виявили, що алгоритми не створюють нових упереджень.

- Дослідники запропонували рішення для покращення справедливості ШІ.

Порівняння показників

| Показник | Значення | Норма |

|---|---|---|

| Дискримінація жінок | висока | низька |

| Відмова у кредитах | часта | рідка |

Висновки

Науковці підкреслюють, що забезпечення справедливості в ШІ є тривалим процесом, що вимагає залучення громад, постійного моніторингу та відповідальності компаній за свої алгоритми.